DESCRIPCIÓN

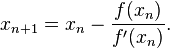

El método de Newton-Raphson es un método abierto, en el sentido de que su convergencia global no está garantizada. La única manera de alcanzar la convergencia es seleccionar un valor inicial lo suficientemente cercano a la raíz buscada. Así, se ha de comenzar la iteración con un valor razonablemente cercano al cero (denominado punto de arranque o valor supuesto). La relativa cercanía del punto inicial a la raíz depende mucho de la naturaleza de la propia función; si ésta presenta múltiples puntos de inflexión o pendientes grandes en el entorno de la raíz, entonces las probabilidades de que el algoritmo diverja aumentan, lo cual exige seleccionar un valor supuesto cercano a la raíz. Una vez que se ha hecho esto, el método linealiza la función por la recta tangente en ese valor supuesto. La abscisa en el origen de dicha recta será, según el método, una mejor aproximación de la raíz que el valor anterior. Se realizarán sucesivas iteraciones hasta que el método haya convergido lo suficiente. f'(x)= 0 Sea f : [a, b] -> R función derivable definida en el intervalo real [a, b]. Empezamos con un valor inicial x0 y definimos para cada número natural n

Donde f ' denota la derivada de f.

Nótese que el método descrito es de aplicación exclusiva para funciones de una sola variable con forma analítica o implícita conocible. Existen variantes del método aplicables a sistemas discretos que permiten estimar las raíces de la tendencia, así como algoritmos que extienden el método de Newton a sistemas multivariables, sistemas de ecuaciones, etc.

ALGORITMO

Tres son las formas principales por las que tradicionalmente se ha obtenido el algoritmo de Newton-Raphson.

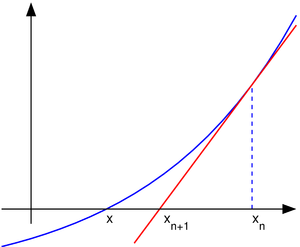

La primera de ellas es una simple interpretación geométrica. En efecto, atendiendo al desarrollo geométrico del método de la secante, podría pensarse en que si los puntos de iteración están lo suficientemente cerca (a una distancia infinitesimal), entonces la secante se sustituye por la tangente a la curva en el punto. Así pues, si por un punto de iteración trazamos la tangente a la curva, por extensión con el método de la secante, el nuevo punto de iteración se tomará como la abscisa en el origen de la tangente (punto de corte de la tangente con el eje X). Esto es equivalente a linealizar la función, es decir, f se reemplaza por una recta tal que contiene al punto ( ,

,  (

( )) y cuya pendiente coincide con la derivada de la función en el punto,

)) y cuya pendiente coincide con la derivada de la función en el punto,  . La nueva aproximación a la raíz,

. La nueva aproximación a la raíz,  , se logra la intersección de la función lineal con el eje X de abscisas. Matemáticamente:

, se logra la intersección de la función lineal con el eje X de abscisas. Matemáticamente:

,

,  (

( )) y cuya pendiente coincide con la derivada de la función en el punto,

)) y cuya pendiente coincide con la derivada de la función en el punto,  . La nueva aproximación a la raíz,

. La nueva aproximación a la raíz,  , se logra la intersección de la función lineal con el eje X de abscisas. Matemáticamente:

, se logra la intersección de la función lineal con el eje X de abscisas. Matemáticamente:

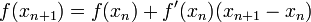

Una forma alternativa de obtener el algoritmo es desarrollando la función f(x) en serie de Taylor, para un entorno del punto  : En la ilustración adjunta del método de Newton se puede ver que

: En la ilustración adjunta del método de Newton se puede ver que  es una mejor aproximación que

es una mejor aproximación que  para el cero (x) de la función f.

para el cero (x) de la función f.

: En la ilustración adjunta del método de Newton se puede ver que

: En la ilustración adjunta del método de Newton se puede ver que  es una mejor aproximación que

es una mejor aproximación que  para el cero (x) de la función f.

para el cero (x) de la función f.

Si se trunca el desarrollo a partir del término de grado 2, y evaluamos en  :

:

:

:

Si además se acepta que  tiende a la raíz, se ha de cumplir que

tiende a la raíz, se ha de cumplir que  , luego, sustituyendo en la expresión anterior, obtenemos el algoritmo.

, luego, sustituyendo en la expresión anterior, obtenemos el algoritmo.

tiende a la raíz, se ha de cumplir que

tiende a la raíz, se ha de cumplir que  , luego, sustituyendo en la expresión anterior, obtenemos el algoritmo.

, luego, sustituyendo en la expresión anterior, obtenemos el algoritmo.

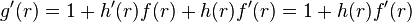

Finalmente, hay que indicar que el método de Newton-Raphson puede interpretarse como un método de iteración de punto fijo. Así, dada la ecuación  , se puede considerar el siguiente método de iteración de punto fijo:

, se puede considerar el siguiente método de iteración de punto fijo:

, se puede considerar el siguiente método de iteración de punto fijo:

, se puede considerar el siguiente método de iteración de punto fijo:

Se escoge h (x) de manera que g'(r)=0 (r es la raíz buscada). Dado que g'(r) es:

Entonces:

Como h (x) no tiene que ser única, se escoge de la forma más sencilla:

Por tanto, imponiendo subíndices:

Expresión que coincide con la del algoritmo de Newton-Raphson

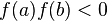

Teorema de Convergencia Global del Método de Newton

Sea ![f\in{\mathcal{C}^2[a,b]}](http://upload.wikimedia.org/math/4/3/1/431e77df57656500ad40b43f8e531e28.png) verificando1 :

verificando1 :

![f\in{\mathcal{C}^2[a,b]}](http://upload.wikimedia.org/math/4/3/1/431e77df57656500ad40b43f8e531e28.png) verificando1 :

verificando1 :

para todo

para todo ![x\in{[a,b]}](http://upload.wikimedia.org/math/8/0/7/8072fabc06d85b2a880e3e1919be533b.png)

para todo

para todo ![x,y\in{[a,b]}](http://upload.wikimedia.org/math/4/a/c/4ac237fa866f0eda64ebd6a1067df6c6.png)

Entonces existe un único ![s\in{[a,b]}](http://upload.wikimedia.org/math/d/e/e/dee2231647a98cfdaba82523c5914455.png) tal que

tal que  por lo que la sucesión converge a s.

por lo que la sucesión converge a s.

![s\in{[a,b]}](http://upload.wikimedia.org/math/d/e/e/dee2231647a98cfdaba82523c5914455.png) tal que

tal que  por lo que la sucesión converge a s.

por lo que la sucesión converge a s.Estimación del Error

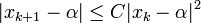

Se puede demostrar que el método de Newton-Raphson tiene convergencia cuadrática: si  es raíz, entonces:

es raíz, entonces:

es raíz, entonces:

es raíz, entonces:

para una cierta constante  . Esto significa que si en algún momento el error es menor o igual a 0,1, a cada nueva iteración doblamos (aproximadamente) el número de decimales exactos. En la práctica puede servir para hacer una estimación aproximada del error:

. Esto significa que si en algún momento el error es menor o igual a 0,1, a cada nueva iteración doblamos (aproximadamente) el número de decimales exactos. En la práctica puede servir para hacer una estimación aproximada del error:

. Esto significa que si en algún momento el error es menor o igual a 0,1, a cada nueva iteración doblamos (aproximadamente) el número de decimales exactos. En la práctica puede servir para hacer una estimación aproximada del error:

. Esto significa que si en algún momento el error es menor o igual a 0,1, a cada nueva iteración doblamos (aproximadamente) el número de decimales exactos. En la práctica puede servir para hacer una estimación aproximada del error:

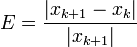

Error relativo entre dos aproximaciones sucesivas:

Con lo cual se toma el error relativo como si la última aproximación fuera el valor exacto. Se detiene el proceso iterativo cuando este error relativo es aproximadamente menor que una cantidad fijada previamente.

EJEMPLO:

Consideremos el problema de encontrar un número positivo x tal que cos(x) = x3. Podríamos tratar de encontrar el cero de f(x) = cos(x) - x3.

Sabemos que f '(x) = -sin(x) - 3x2. Ya que cos(x) ≤ 1 para todo x y x3 > 1 para x>1, deducimos que nuestro cero está entre 0 y 1. Comenzaremos probando con el valor inicial x0 = 0,5

Los dígitos correctos están subrayados. En particular, x6 es correcto para el número de decimales pedidos. Podemos ver que el número de dígitos correctos después de la coma se incrementa desde 2 (para x3) a 5 y 10, ilustando la convergencia cuadrática.

No hay comentarios:

Publicar un comentario

Nota: solo los miembros de este blog pueden publicar comentarios.